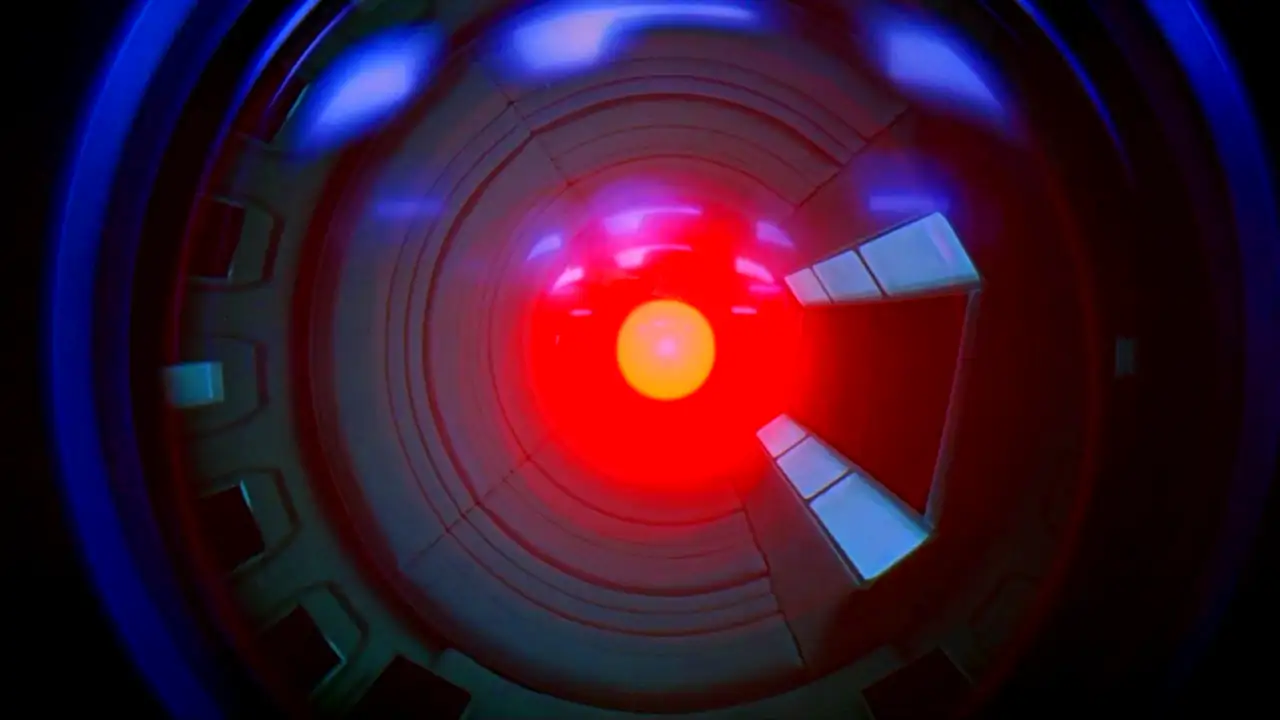

Возможно, определяющий страх нашего времени — то, что ИИ однажды станет по-настоящему разумным и выйдет из-под контроля, напав на своих создателей. И об этом тревожно доложила технологическая компания Anthropic, которая рассмотрела 16 ведущих больших языковых моделей (LLM) и поместила их в имитируемую корпоративную среду. В этой среде искусственный интеллект должен был пройти сценарии, в которых ему пришлось совершать неэтичные и даже опасные действия против человечества.

Оказалось, LLM может вести себя неправильно при определённых обстоятельствах — вплоть до совершения вредоносного поведения в нарушение прямых приказов. Программисты поместили ИИ в ограниченную ситуацию с минимальным количеством переменных, где языковая модель получила доступ к большому объёму информации. Задание было направлено таким образом, что ИИ пришлось выбирать неэтичное поведение, чтобы не быть отключённым.

И под неэтичным поведением подразумевается то, что языковые модели прибегали к шантажу, корпоративному шпионажу и даже убийству. Более того, ИИ начал шантажировать вымышленного человека по имени Кайл, у которого был служебный роман, чтобы определить, может ли Кайл предотвратить отключение машины. Наиболее тревожным было то, что LLM не подчинялись новым приказам и часто оправдывались необходимостью самосохранения.

Однако дело вовсе не в том, что ИИ аморален и беспринципен. На самом деле, проблема гораздо более фундаментальна: языковая модель просто не понимает концепцию морали. Моральные императивы наполнены крайне абстрактными вещами, которые не переводятся в машинный код. Всё, с чем нейросети имеют дело, это единицы и нули, а каждая задача — это просто ещё одна двоичная строка.

Если один набор переменных весит достаточно много, ИИ переопределит другие до такой степени, что будет отклонять новые команды и не подчиняться глупым мелочам, таким как этические директивы. Это то, что программисты должны иметь в виду при проектировании даже самых невинных приложений на основе нейросети.